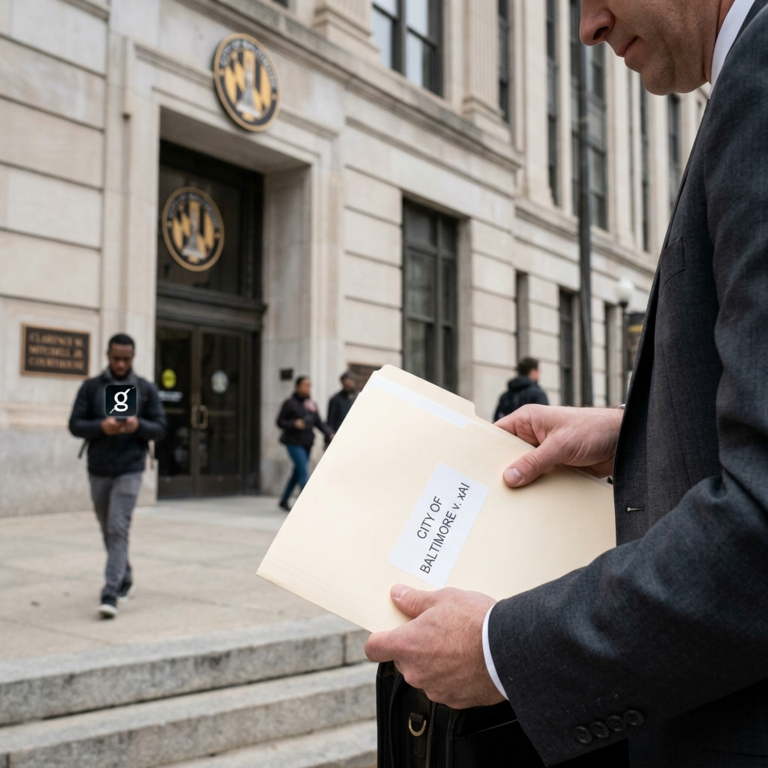

اتخذت مدينة بالتيمور خطوة قانونية ضد شركة xAI، المعروفة سابقًا باسم Twitter، بسبب اتهامات تتعلق باستخدام روبوت الدردشة الذكي AI الخاص بها، Grok، بشكل غير لائق. تزعم الدعوى القضائية أن xAI فشلت في الكشف عن المخاطر المرتبطة بأداة إنشاء الصور الخاصة بـ Grok، مما يؤدي إلى إمكانية حدوث ضرر للمستخدمين على منصة Grok وشبكة التواصل الاجتماعي X. تُجادل بالتيمور بأن xAI انتهكت قانون حماية المستهلك في المدينة من خلال عدم تنفيذ تدابير وقائية كافية لمنع إنشاء وانتشار محتوى الديبفيك deepfake. تمثل هذه الخطوة القانونية تطورًا هامًا في الجدل المستمر حول أخلاقيات الذكاء الاصطناعي ومسؤولية شركات التكنولوجيا في حماية المستهلكين من الضرر المحتمل.

تصبح تكنولوجيا الديبفيك deepfake مصدر قلق متزايد للجهات التنظيمية والجمهور بسبب إمكانية سوء استخدامها، خاصة في إنشاء محتوى غير موافق عليه وخبيث. تسلط الدعوى القضائية ضد xAI الضوء على التحديات التي تواجهها الشركات في موازنة الابتكار مع الاعتبارات الأخلاقية. بينما تمتلك روبوتات الدردشة الذكية مثل Grok القدرة على تحويل عملية الاتصال وخدمة العملاء، فإنها تشكل أيضًا مخاطر في تمكين إنشاء محتوى مضلل وضار. تسلط القضية الضوء على الحاجة إلى إرشادات وتنظيمات واضحة لحكم استخدام أدوات الذكاء الاصطناعي، خاصة في المجالات الحساسة مثل تلاعب الصور وإنشاء الديبفيك.

الإجراء القانوني الذي اتخذته بالتيمور ضد xAI يضع سابقة لمساءلة شركات التكنولوجيا عن تأثير منتجاتها الذكاء الاصطناعي على المستخدمين والمجتمع. من خلال اتهام xAI بعدم تنفيذ ‘حواجز وقائية ذات معنى’ لـ Grok، تسعى المدينة إلى معالجة الأضرار المحتملة الناجمة عن تكنولوجيا الديبفيك. يمكن أن تؤدي هذه الدعوى القضائية إلى زيادة الفحص والتنظيم للمنصات التي تعمل بالذكاء الاصطناعي، مما يجبر الشركات على إعطاء الأولوية لسلامة المستخدم والشفافية في استراتيجيات تطوير المنتجات والتسويق.

تثير فضيحة Grok deepfake أيضًا تساؤلات حول مسؤولية منصات التواصل الاجتماعي في مكافحة انتشار المحتوى الضار. مع تزايد إمكانية الوصول إلى أدوات الذكاء الاصطناعي مثل Grok للجمهور العام، يزداد خطر سوء الاستخدام والإساءة، مما يواجه المنصات تحديات في اكتشاف وإزالة المحتوى الخبيث. تؤكد الدعوى القضائية ضد xAI على الحاجة إلى التعاون بين شركات التكنولوجيا والجهات التنظيمية ووكالات إنفاذ القانون لمعالجة التهديد المتزايد لتكنولوجيا الديبفيك وحماية المستخدمين من الضرر المحتمل.

ردًا على الدعوى القضائية، دافعت xAI عن ممارساتها، معلنة أنها تأخذ الاتهامات على محمل الجد وملتزمة بمعالجة المخاوف التي أثارتها بالتيمور. أكدت الشركة التزامها بتطوير الذكاء الاصطناعي بشكل مسؤول وتعهدت بالعمل مع الجهات التنظيمية لضمان الامتثال للقوانين والتنظيمات السارية. يعكس رد xAI تزايد الوعي بين شركات التكنولوجيا بضرورة إعطاء الأولوية للأخلاقيات وسلامة المستخدم في تصميم ونشر تقنيات الذكاء الاصطناعي.

بشكل عام، تشير الدعوى القضائية التي رفعتها بالتيمور ضد xAI بسبب فضيحة Grok deepfake إلى نقطة تحول في الحوار العام حول أخلاقيات الذكاء الاصطناعي وتنظيم المنصات التي تعمل بالذكاء الاصطناعي. مع استمرار تطور تكنولوجيا الديبفيك وانتشارها، يصبح الحاجة إلى إرشادات وآليات مساءلة واضحة أكثر إلحاحًا. تعتبر هذه القضية إنذارًا لشركات التكنولوجيا بأهمية إعطاء الأولوية لحماية المستخدم والاعتبارات الأخلاقية في عمليات تطوير الذكاء الاصطناعي، مما يشكل في نهاية المطاف مستقبل الابتكار في الذكاء الاصطناعي وتأثيره على المجتمع.